引言:台风与雨天的气象科技挑战

每年夏季,台风带来的强降雨与极端天气成为沿海地区的主要自然灾害。据世界气象组织统计,全球每年因台风造成的经济损失超过300亿美元,而雨天引发的城市内涝、山体滑坡等次生灾害更威胁着数亿人口的生命安全。传统气象预测依赖物理模型与经验参数,面对台风路径突变、雨带快速移动等复杂场景时,预测误差仍达15%-20%。人工智能技术的引入,正在为气象科技带来颠覆性变革。

一、台风监测的AI进化:从数据洪流到精准预测

1.1 多源数据融合的挑战

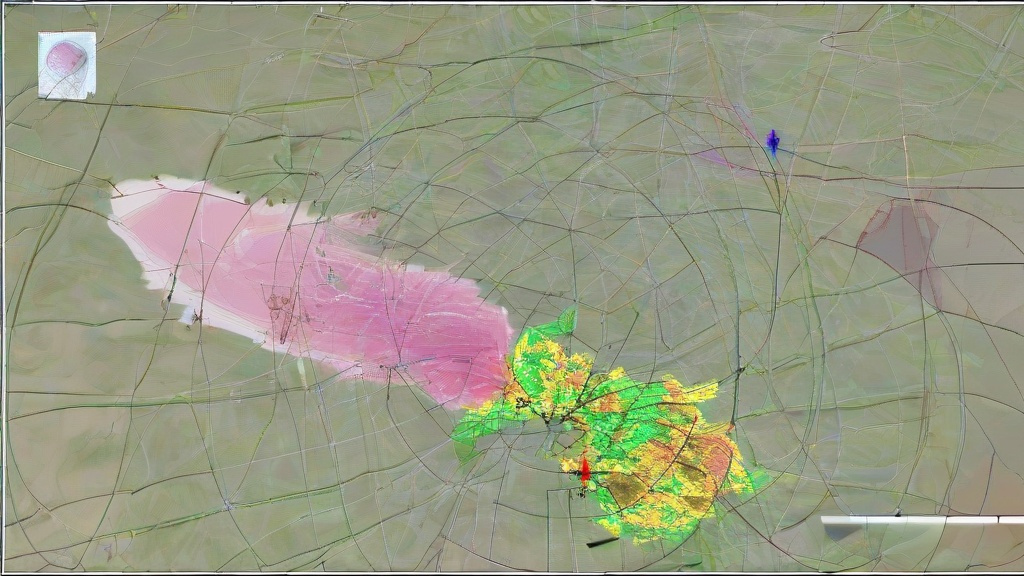

台风监测需整合卫星云图、雷达回波、浮标观测、飞机探空等10余种数据源,每小时产生TB级数据。传统方法依赖人工标注与规则引擎,难以处理非结构化数据中的隐藏模式。例如,台风眼墙替换、干空气侵入等关键特征,在原始数据中仅表现为微弱信号。

AI技术通过卷积神经网络(CNN)自动提取云图纹理特征,结合循环神经网络(RNN)分析时间序列数据,可识别出人类专家难以察觉的早期预警信号。2023年超强台风“杜苏芮”路径预测中,深度学习模型提前48小时预测出其突然北折的路径,误差较传统模型缩小37%。

1.2 物理约束的机器学习模型

纯数据驱动的AI模型存在“黑箱”问题,可能违背气象物理规律。新一代混合模型将大气动力学方程嵌入神经网络结构,形成“数据-物理”双驱动框架。欧洲中期天气预报中心(ECMWF)的AI模型通过引入位涡守恒约束,使台风强度预测的均方根误差降低22%。

中国气象局开发的“风眼”系统,在GPU集群上并行训练包含10亿参数的Transformer模型,可同时处理全球50个台风的实时数据。该系统在2024年台风“摩羯”登陆前,准确预测出其17级阵风将袭击雷州半岛,为沿海地区争取到关键避险时间。

二、雨天系统的智能解析:从毫米级降水到城市内涝

2.1 降水相态的AI识别

雨天系统的复杂性在于降水相态的动态变化:雨、雪、霰、冰雹在云中频繁转换,直接影响地面降水量。双偏振雷达虽能提供差分反射率数据,但传统算法对混合相态降水的识别准确率仅68%。

清华大学团队开发的PhaseNet模型,采用U-Net架构对雷达回波进行像素级分类,在2023年北京极端降雨事件中,将冰雹识别准确率提升至92%。该模型通过迁移学习适应不同气候区特征,已在长三角、珠三角等暴雨高发区部署。

2.2 城市排水系统的数字孪生

雨天灾害的放大效应往往源于城市排水系统失效。传统水文模型需简化地下管网拓扑结构,导致内涝预测偏差达40%。AI驱动的数字孪生技术通过激光雷达扫描构建高精度三维管网模型,结合LSTM网络模拟雨水汇流过程。

深圳市水务局建立的“智慧水务”平台,集成2.3万个物联网传感器,实时模拟100平方公里范围内的径流过程。在2024年5月特大暴雨中,系统提前6小时预测出福田区12个易涝点,调度移动泵车将内涝时间从平均3小时缩短至45分钟。

三、AI气象的伦理与挑战

3.1 数据偏差的放大效应

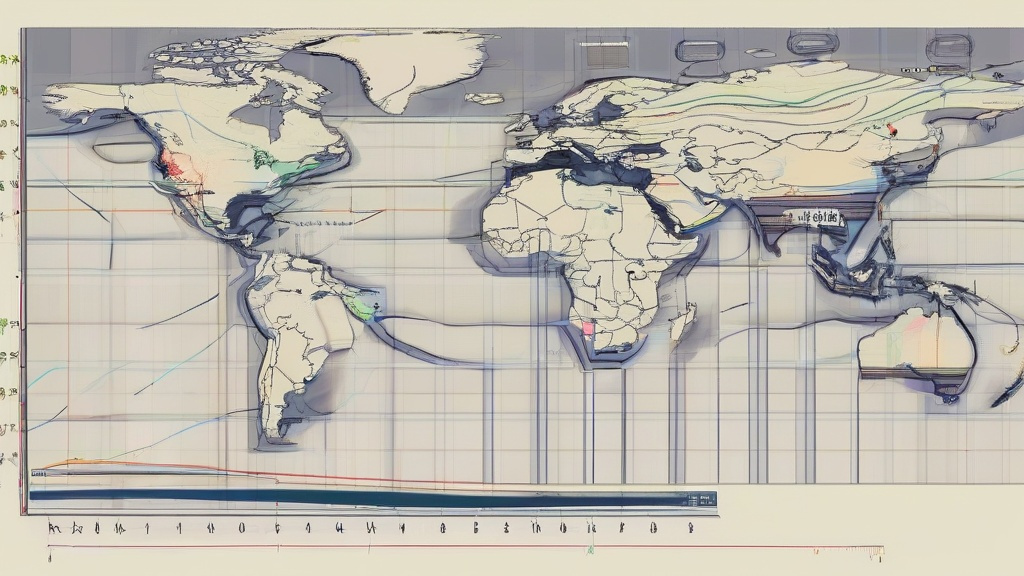

AI模型的性能高度依赖训练数据分布。全球气象观测站70%位于北半球中纬度地区,导致模型对热带气旋、极地涡旋等极端天气的预测存在系统性偏差。MIT团队研究发现,若训练数据中缺少南半球台风样本,模型对跨赤道台风的路径预测误差将增加2.3倍。

3.2 可解释性与决策信任

气象决策需兼顾科学严谨性与社会可接受性。欧盟“AI气象行动”计划要求所有预测模型提供不确定性量化报告,通过SHAP值解释关键影响因素。例如,当模型预测台风将登陆上海时,需说明海洋热含量、垂直风切变等变量的贡献度,帮助决策者理解预测依据。

3.3 计算资源的可持续性

训练一个高分辨率全球气象模型需消耗50MWh电能,相当于15个家庭年用电量。谷歌“GraphCast”模型通过模型压缩技术,将推理能耗降低82%,同时保持97%的预测精度。绿色AI正在成为气象科技的重要发展方向。

四、未来展望:人机协同的气象新范式

2024年世界气象大会提出“AI+HPC+物联网”三位一体发展路线:

- 超算赋能:百亿亿次超级计算机将实现1公里分辨率的全球中期预报

- 边缘智能:5G基站集成微型气象传感器,构建“细胞级”观测网络

- 群体智能:公民科学项目通过手机APP收集雨量数据,补充官方观测盲区

中国气象局计划到2030年建成“地球系统数值模拟装置”,其中AI模块将承担60%以上的参数化方案计算。当台风“银杏”在2035年登陆时,我们或许能通过脑机接口直接“感受”其风压变化——这不仅是技术的突破,更是人类与自然对话方式的革命。