当手机弹出“未来三小时有雨”的提示时,你是否想过,这场雨是如何被“算”出来的?数值预报——这个听起来高冷的科学术语,实则是现代天气预报的“大脑”。它通过超级计算机对大气运动进行数学建模,将云层、风场、温度等要素转化为亿万级数据,在虚拟世界中预演未来天气。而雨天,作为最易引发公众关注的天气现象,正是检验数值预报精准度的“试金石”。

数值预报的“数字魔法”:从方程组到天气图

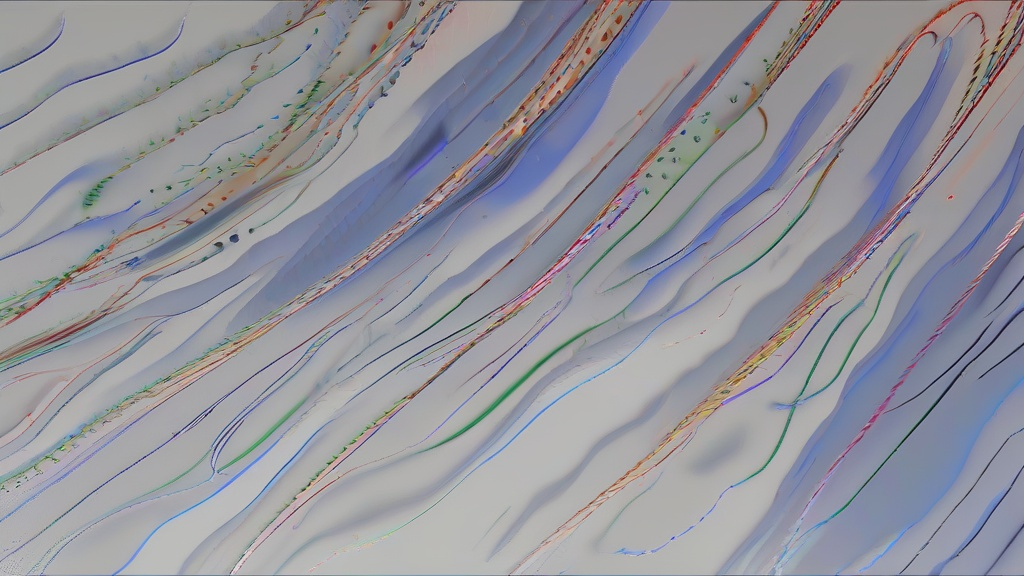

数值预报的核心,是求解大气运动的偏微分方程组。这些方程描述了空气密度、速度、温度、湿度等物理量随时间的变化规律。想象一下,地球大气是一个由无数微小气块组成的巨大系统,每个气块的运动都受到压力梯度力、科里奥利力、摩擦力等复杂作用。数值预报要做的是,将这些连续的物理过程离散化为网格点上的数值计算。

以雨天预测为例,模型需要追踪水汽的输送与凝结过程。当暖湿空气被抬升至冷凝高度,水汽饱和后形成云滴,进而合并成雨滴——这一过程在数值模型中被分解为多个步骤:首先计算水汽通量(单位时间通过单位面积的水汽质量),再通过微物理方案模拟云滴的核化、碰并与增长,最后结合降水效率参数确定降水量。例如,WRF(Weather Research and Forecasting)模型中,Kessler方案用于暖云降水,Lin方案则能处理冰相过程,不同方案的选取直接影响雨天预测的细节。

超级计算机是数值预报的“算力引擎”。以中国气象局的“派-曙光”为例,其每秒可进行百亿亿次浮点运算,能在1小时内完成全球9公里分辨率、区域3公里分辨率的10天预报。这种计算能力使得模型能捕捉到中小尺度天气系统——如局地雷暴、锋面雨带——的演化,而这些正是传统经验预报难以触及的领域。

雨天预测的“隐形挑战”:模型为何会“翻车”?

尽管数值预报已能提前数天提示降雨概率,但“局部地区有雨”的模糊表述仍常被吐槽。这背后,是雨天预测面临的三大难题。

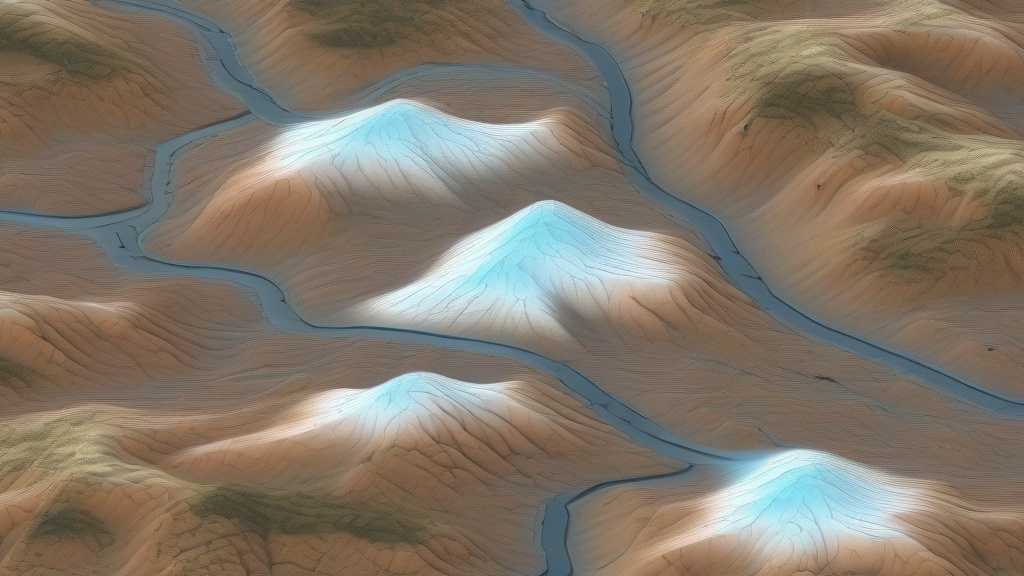

第一,地形影响被简化。山脉会强迫气流抬升,增强降水(如迎风坡的“雨影效应”),但模型网格通常无法完全匹配真实地形。例如,青藏高原的复杂地形对西南季风降水的影响,在10公里分辨率模型中仍可能被平滑处理,导致降水中心位置偏差。

第二,初始场误差被放大。数值预报依赖地面观测、卫星遥感、雷达探测等数据构建初始状态,但观测站点分布不均(如海洋、沙漠地区数据稀疏),且仪器误差、数据同化算法缺陷会导致初始场存在不确定性。这些误差会在模型积分过程中被非线性放大,形成“蝴蝶效应”——初始场0.1℃的温度偏差,可能3天后导致数百公里外的降雨量差异超50%。

第三,云物理过程参数化局限。云滴碰并、冰晶繁生等微物理过程发生在毫米级尺度,远小于模型网格(通常公里级),只能通过参数化方案近似描述。不同参数化方案对降水效率的假设差异显著,例如,某些方案可能高估层状云降水,低估对流云降水,导致雨天类型(持续性降雨 vs 短时强降水)预测偏差。

突破边界:科技如何让雨天预报更“靠谱”?

面对挑战,气象科技正从三个方向突围。

一是提升模型分辨率。欧洲中期天气预报中心(ECMWF)的IFS模型已实现全球9公里分辨率,中国气象局的CMA-MESO区域模型则达到3公里。更高分辨率意味着能更精确刻画地形、城市热岛等下垫面特征,以及中小尺度对流系统的组织结构。例如,2023年台风“杜苏芮”登陆期间,3公里模型成功捕捉到其眼墙置换过程中的降水分布变化,为防灾减灾提供关键支持。

二是融合多源观测数据。卫星雷达(如GPM双频降水雷达)可提供三维降水结构,地面雷达网能实时监测低空风场,无人机探测能填补海洋、山区观测空白。通过机器学习算法优化数据同化流程,可显著降低初始场误差。例如,华为云盘古气象大模型通过融合全球4000+站点观测数据,将台风路径预报误差较传统模型降低25%。

三是发展集合预报技术。单一定量预报易受初始场误差影响,而集合预报通过运行多个略不同的初始场或模型版本,生成一组可能的天气情景。例如,ECMWF的51成员集合预报系统可提供降雨概率分布,用户能直观看到“未来24小时降水超过50毫米的概率是70%”,而非单一的“有雨”或“无雨”。这种概率化表达更符合天气的不确定性本质。

从1946年Charney等人首次用ENIAC计算机求解大气方程组,到如今AI与数值预报深度融合,人类对雨天的预测能力已实现质的飞跃。但天气系统的复杂性决定了预报永远存在误差——数值预报的价值,不在于“100%准确”,而在于通过科学计算,将不确定性转化为可量化的风险信息,帮助社会提前应对。下一次看到“局部有雨”的提示时,不妨多一份理解:这背后,是无数科学家对大气数字密码的不懈破译。