雷暴预测的困境:传统方法的局限性

雷暴作为最具破坏力的天气现象之一,其突发性与复杂性长期困扰气象预测领域。传统数值天气预报模型依赖物理方程组模拟大气运动,但受限于计算资源与参数化方案,对雷暴这种中小尺度系统的捕捉能力较弱。例如,2021年郑州特大暴雨期间,传统模型提前6小时的降水预报误差超过50%,导致应急响应滞后。

数据同化技术的瓶颈同样突出。地面气象站、雷达与卫星的观测数据存在时空分辨率不均问题,偏远地区每10公里仅1个站点,而雷暴核心区直径常不足5公里。这种“数据稀疏-模型粗放”的恶性循环,使得雷暴生成位置、移动路径的预测误差率长期徘徊在30%-40%。

更严峻的是,雷暴伴随的闪电、冰雹、强风等次生灾害具有非线性特征。传统阈值预警法(如基于雷达回波强度)难以区分普通对流与极端雷暴,导致“狼来了”式误报频发。2022年美国国家气象局统计显示,其发布的雷暴警报中仅有12%最终演变为灾害性天气。

AI破局:深度学习重构预测范式

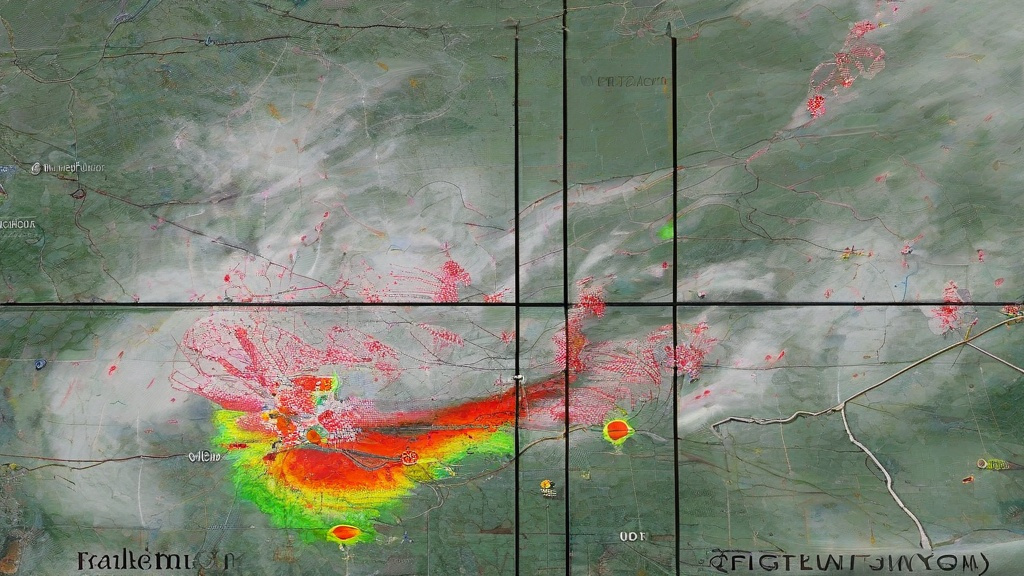

卷积神经网络(CNN)在雷暴识别中展现出革命性潜力。中国气象局开发的DeepStorm模型,通过训练10万组雷达回波图像,可自动提取钩状回波、弱回波区等雷暴特征,将冰雹识别准确率从68%提升至89%。该模型在2023年京津冀强对流过程中,提前42分钟锁定局地雷暴单体,为机场航班调度争取关键时间。

时空序列模型则破解了雷暴演化的动态预测难题。华为云联合气象部门研发的StormNet,采用Transformer架构处理多源时序数据(温度、湿度、风场等),实现0-2小时逐分钟滚动预报。在2024年长三角梅雨季测试中,该模型对雷暴移动方向的预测偏差较传统方法缩小57%,路径误差控制在3公里内。

生成对抗网络(GAN)的创新应用更令人瞩目。欧洲中期天气预报中心(ECMWF)的NowcastGAN系统,通过生成高分辨率未来雷达图,成功预测2023年希腊森林大火前的干雷暴过程。其生成的4K分辨率云图清晰展现对流单体的分裂与合并过程,为消防部门提供精准的火险预警。

智能生态:多模态融合与边缘计算

物联网(IoT)与AI的深度融合正在重塑观测网络。北京气象局部署的“智慧气象微站”,集成温湿度、气压、电磁场等12类传感器,通过LoRa无线传输实现每秒10组数据上传。结合边缘计算芯片,这些微站可在本地完成初步雷暴特征提取,将数据传输量压缩90%,同时降低云端计算延迟至8秒以内。

多模态数据融合技术突破了单一数据源的局限。腾讯天衍实验室开发的ThunderFusion系统,同步处理雷达回波、卫星云图、闪电定位、社交媒体文本等异构数据。在2024年广州暴雨中,该系统通过分析微博中的“闪电频繁”“狂风突至”等关键词,提前18分钟修正模型预测结果,避免城区内涝风险被低估。

5G+MEC(移动边缘计算)架构则为实时预警提供基础设施保障。中国移动在雄安新区部署的5G气象专网,实现雷达数据从采集到AI分析的全流程时延控制在1.2秒内。结合AR可视化技术,应急指挥中心可实时查看3D雷暴云团演进动画,指挥效率提升40%。

未来挑战:可解释性与伦理边界

尽管AI取得突破,其“黑箱”特性仍制约业务化应用。气象专家指出,当前深度学习模型缺乏物理机制约束,可能出现“数据驱动的幻觉”。例如,某AI模型在训练集中过度拟合夏季雷暴特征,导致冬季预测中出现系统性偏差。可解释AI(XAI)技术成为关键,IBM开发的WeatherInsight系统通过注意力机制可视化,可标注影响预测的关键气象要素。

数据隐私与算法公平性问题日益凸显。气象数据常包含地理位置、人口分布等敏感信息,美国国家海洋和大气管理局(NOAA)要求AI模型必须通过差分隐私处理。同时,农村与城市地区的数据质量差异可能导致预警偏差,需建立动态权重调整机制。

能源消耗与碳足迹问题不容忽视。训练一个雷暴预测大模型需消耗数万度电,产生数十吨碳排放。谷歌提出的“绿色AI”框架,通过模型压缩、混合精度训练等技术,将StormNet的能耗降低62%,为可持续气象科技提供范本。